Seedance 全版本进化史:从1.0到2.0,字节跳动的AI视频模型都经历了什么?

一文看懂Seedance 1.0、1.5 Pro、2.0的优缺点与核心升级

如果你关注AI视频生成,一定听说过Seedance——这个来自字节跳动的国产模型,在过去一年里完成了三次重要迭代。我的网站已经接入了它的前三个版本,👉 Z-Video AI视频生成工具,今天我们就来完整回顾一下,这个被称作“国产AI视频之王”的产品,究竟是如何一步步进化的。

起源:一颗种子的萌芽

Seedance的名字很有意思——Seed(种子)+ Dance(跳舞),寓意“种子跳舞”,从种子到生长的过程。

早在2023年,字节就启动了Seedance的初代原型研发,但当时仅用于内部测试。真正的转折点在2025年初,字节Seed团队迎来新掌门人吴永辉,产品化进程开始加速。半年后,1.0版本正式亮相。

Seedance 1.0:从0到1的破局者(2025.6)

作为奠基之作,1.0的核心任务是解决“能不能生成”的问题。

它做到了什么?

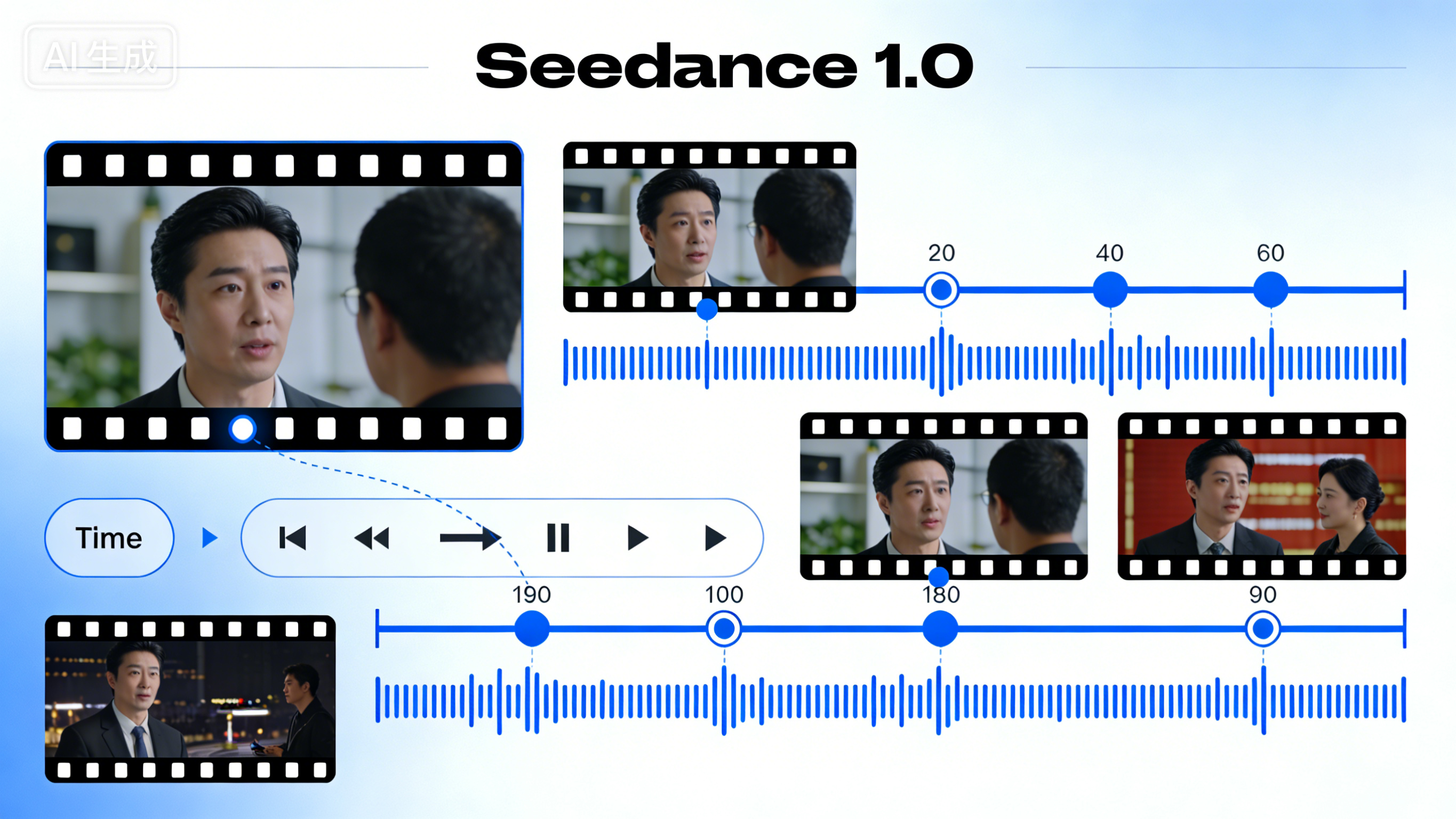

- 支持文字与图片输入,生成2-3个镜头切换的10秒1080P视频

- 生成5秒视频仅需41.4秒(L20测试环境)

- 具备原生多镜头叙事能力,能实现远、中、近景自然过渡

实测表现:镜头语言能理解基本拍法,奔跑、水花等动态效果较好。但局限也很明显——生成时长基本控制在10秒以内,需要多轮“抽卡”才能得到满意结果,对复杂物理交互的处理能力有限。

一句话总结:它证明了这条路走得通,但还不够稳。

Seedance 1.5 Pro:音画同步的突破者(2025.12)

半年后的1.5 Pro版本,完成了一次“听觉革命”。

核心突破:原生音视频联合生成

- 采用双分支扩散变换器(MMDiT)架构,视频与音频同步生成

- 实现毫秒级音画同步,口型对齐精准

- 支持多人多语言对话(含中文方言)

叙事能力同步升级:增强语义理解,具备电影级运镜控制(长镜头跟随、希区柯克变焦等),能精准捕捉运动细节和人物情绪。

局限:定位仍是“生产工具”而非“世界模拟器”,在复杂物理模拟上不及同期Sora。

一句话总结:画面还不够真,但声音已经对得上了。

Seedance 2.0:导演级的全能王者(2026.2)

最新的2.0版本,带来了一场“可控性革命”。

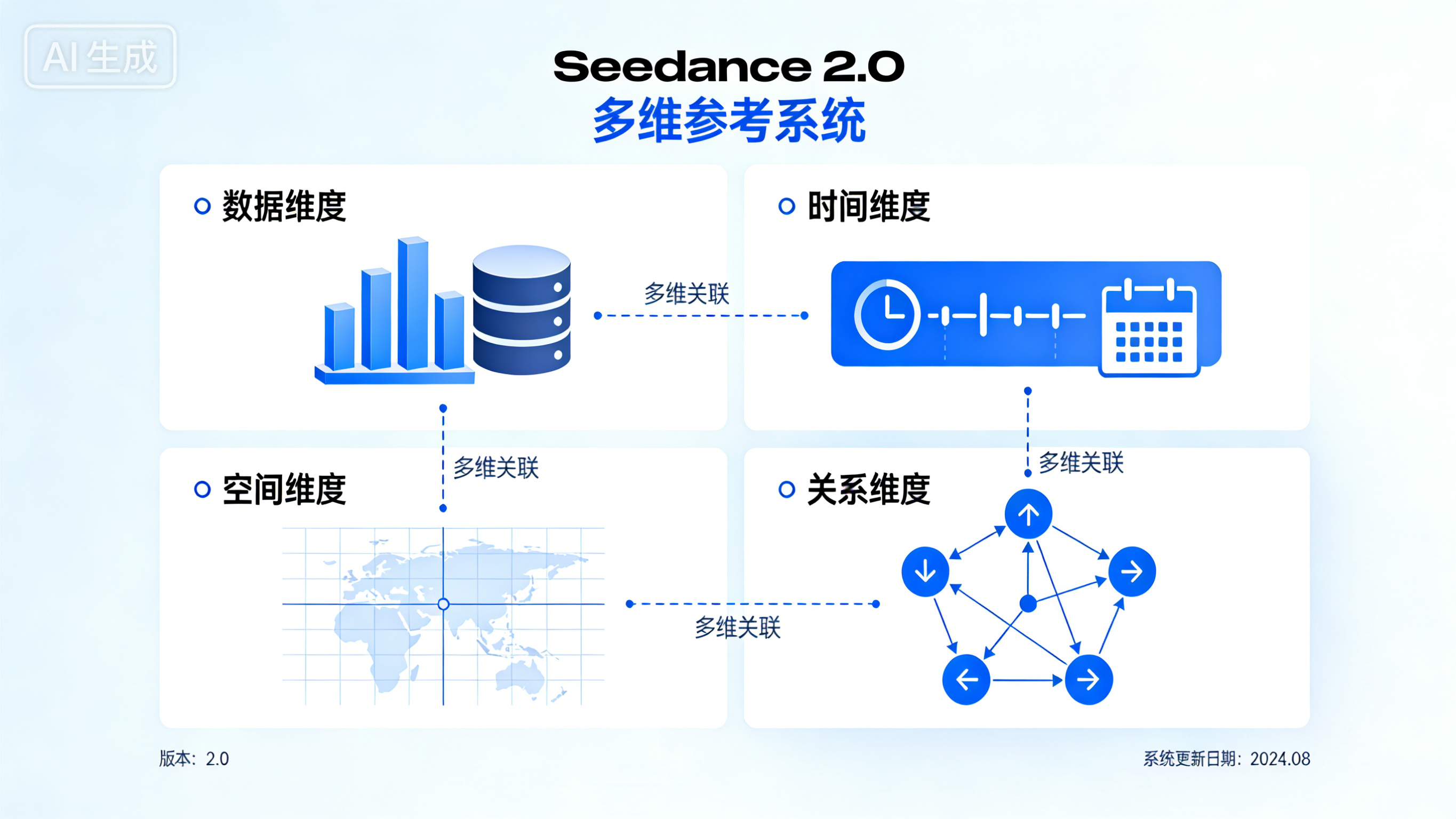

划时代突破:多维参考系统

- 支持同时上传多达9张图片、3段视频、3段音频作为参考

- 引入“@引用系统”:可在提示词中精确指定使用哪张图的角色、哪段视频的动作

- 可调整每个参考素材的“影响权重”,实现精细控制

一致性突破:解决了AI视频最大的痛点——角色在多镜头切换中保持面部特征和服饰细节不变。从“抽卡”变成了“可预测的生产工具”。

技术升级:生成2K视频速度比同类快约30%,支持多场景序列生成,自动分解镜头(远景-中景-特写)。

当前局限:复杂物理效果仍有不足(液体流动、布料褶皱),长视频存在“记忆衰减”需人工剪辑,“真人素材参考”功能因伦理风险被暂停。

一句话总结:开始听人话了,但物理世界还没完全搞懂。

各版本速览

| 版本 | 发布时间 | 核心能力 | 一句话总结 |

|---|---|---|---|

| Seedance 1.0 | 2025.6 | 文生/图生视频,多镜头切换 | 能用了,但不稳 |

| Seedance 1.5 Pro | 2025.12 | 音视频联合生成 | 声音对得上了 |

| Seedance 2.0 | 2026.2 | 多模态参考,导演级控制 | 开始听人话了 |

我的网站已经接入了Seedance的前三个版本,见证了这款国产AI视频模型从青涩到成熟的每一步。

虽然2.0的“真人素材参考”功能被暂停,但其核心能力——导演级控制、强一致性、原生音视频——已经让AI视频从“玩具”变成了“工具”。