Seedance 全版本進化史:從 1.0 到 2.0,字節跳動的 AI 影片模型經歷了什麼?

一文看懂Seedance 1.0、1.5 Pro、2.0的優缺點與核心升級

如果你關注AI影片生成,一定聽過Seedance——這個來自字節跳動的國產模型,在過去一年裡完成了三次重要迭代。我的網站已經接入了它的前三個版本,👉 Z-Video AI影片生成工具,今天我們就來完整回顧一下,這個被稱為「國產AI影片之王」的產品,究竟是如何一步步進化的。

起源:一顆種子的萌芽

Seedance的名字很有意思——Seed(種子)+ Dance(跳舞),寓意「種子跳舞」,從種子到生長的過程。

早早在2023年,字節就啟動了Seedance的初代原型研發,但當時僅用於內部測試。真正的轉折點在2025年初,字節Seed團隊迎來新掌門人吳永輝,產品化進程開始加速。半年後,1.0版本正式亮相。

Seedance 1.0:從0到1的破局者(2025.6)

作為奠基之作,1.0的核心任務是解決「能不能生成」的問題。

它做到了什麼?

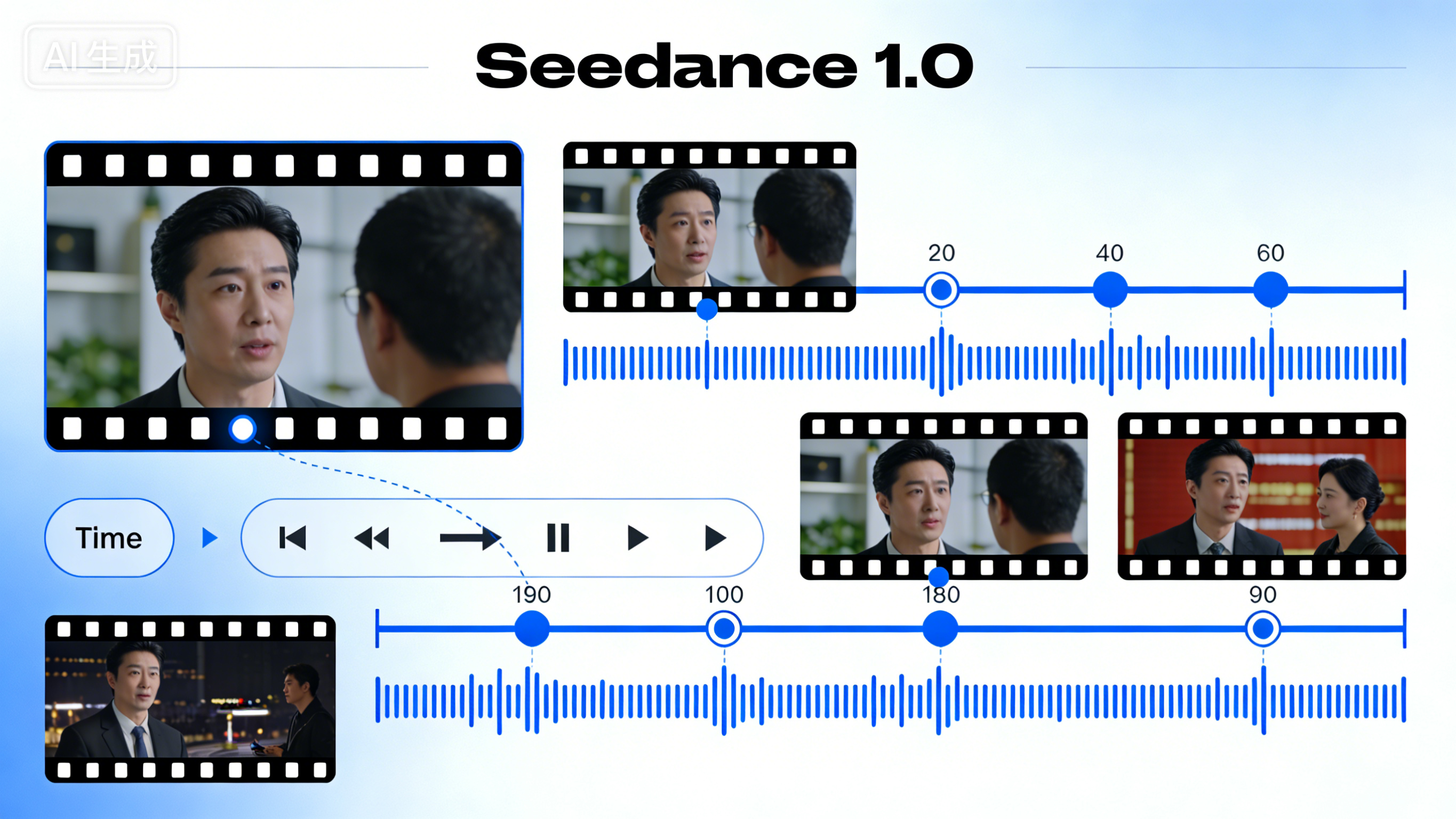

- 支援文字與圖片輸入,生成2-3個鏡頭切換的10秒1080P影片

- 生成5秒影片僅需41.4秒(L20測試環境)

- 具備原生多鏡頭敘事能力,能實現遠、中、近景自然過渡

實測表現:鏡頭語言能理解基本拍法,奔跑、水花等動態效果較好。但局限也很明顯——生成時長基本控制在10秒以內,需要多輪「抽卡」才能得到滿意結果,對複雜物理交互的處理能力有限。

一句話總結:它證明了這條路走得通,但還不夠穩。

Seedance 1.5 Pro:音畫同步的突破者(2025.12)

半年後的1.5 Pro版本,完成了一次「聽覺革命」。

核心突破:原生音畫聯合生成

- 採用雙分支擴散變換器(MMDiT)架構,影片與音訊同步生成

- 實現毫秒級音畫同步,口型對齊精準

- 支援多人多語言對話(含中文方言)

敘事能力同步升級:增強語義理解,具備電影級運鏡控制(長鏡頭跟隨、希區柯克變焦等),能精準捕捉運動細節和人物情緒。

局限:定位仍是「生產工具」而非「世界模擬器」,在複雜物理模擬上不及同期Sora。

一句話總結:畫面還不夠真,但聲音已經對得上了。

Seedance 2.0:導演級的全能王者(2026.2)

最新的2.0版本,帶來了一場「可控性革命」。

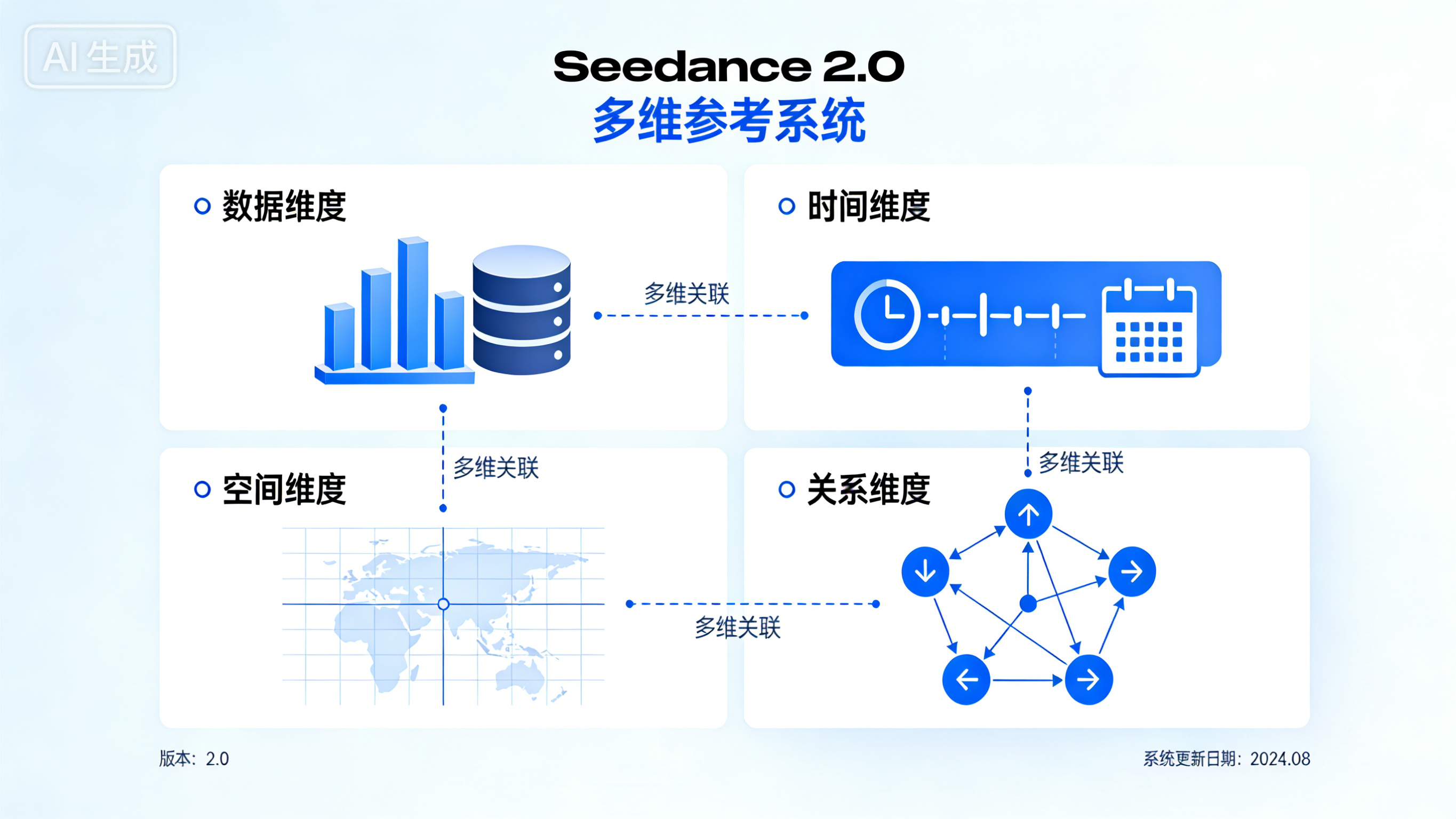

劃時代突破:多維參考系統

- 支援同時上傳多達9張圖片、3段影片、3段音訊作為參考

- 引入「@引用系統」:可在提示詞中精確指定使用哪張圖的角色、哪段影片的動作

- 可調整每個參考素材的「影響權重」,實現精細控制

一致性突破:解決了AI影片最大的痛點——角色在多鏡頭切換中保持面部特徵和服飾細節不變。從「抽卡」變成了「可預測的生產工具」。

技術升級:生成2K影片速度比同類快約30%,支援多場景序列生成,自動分解鏡頭(遠景-中景-特寫)。

當前局限:複雜物理效果仍有不足(液體流動、布料褶皺),長影片存在「記憶衰減」需人工剪輯,「真人素材參考」功能因倫理風險被暫停。

一句話總結:開始聽人話了,但物理世界還沒完全搞懂。

各版本速覽

| 版本 | 發布時間 | 核心能力 | 一句話總結 |

|---|---|---|---|

| Seedance 1.0 | 2025.6 | 文生/圖生影片,多鏡頭切換 | 能用了,但不穩 |

| Seedance 1.5 Pro | 2025.12 | 音畫聯合生成 | 聲音對得上了 |

| Seedance 2.0 | 2026.2 | 多模態參考,導演級控制 | 開始聽人話了 |

我的網站已經接入了Seedance的前三個版本,見證了這款國產AI影片模型從青澀到成熟的每一步。

雖然2.0的「真人素材參考」功能被暫停,但其核心能力——導演級控制、強一致性、原生音畫——已經讓AI影片從「玩具」變成了「工具」。