Modelos GGUF de Z-Image por GGUF-Org

Versiones oficiales cuantizadas GGUF de los modelos Z-Image Turbo para despliegue con poca VRAM (6GB+), optimizadas para ComfyUI con múltiples niveles de cuantización

Resumen

GGUF-Org proporciona versiones oficiales cuantizadas GGUF de Z-Image Turbo, permitiendo el despliegue en GPUs de consumo con tan solo 6GB de VRAM. Admite múltiples niveles de cuantización, incluyendo Q3_K_S, IQ4_NL e IQ4_XS para diferentes equilibrios entre VRAM y calidad.

Características

- Múltiples niveles de cuantización: Q3_K_S (6GB), IQ4_NL/IQ4_XS (8GB)

- Compatible con ComfyUI a través de GGUF-Connector o la extensión ComfyUI-GGUF

- Soporta varias variantes de codificador de texto Qwen3

- Formato de archivo mapeado en memoria para una carga eficiente

- Mantiene la calidad de imagen mientras reduce los requisitos de VRAM hasta en un 70%

- Incluye modelos VAE y codificador de texto

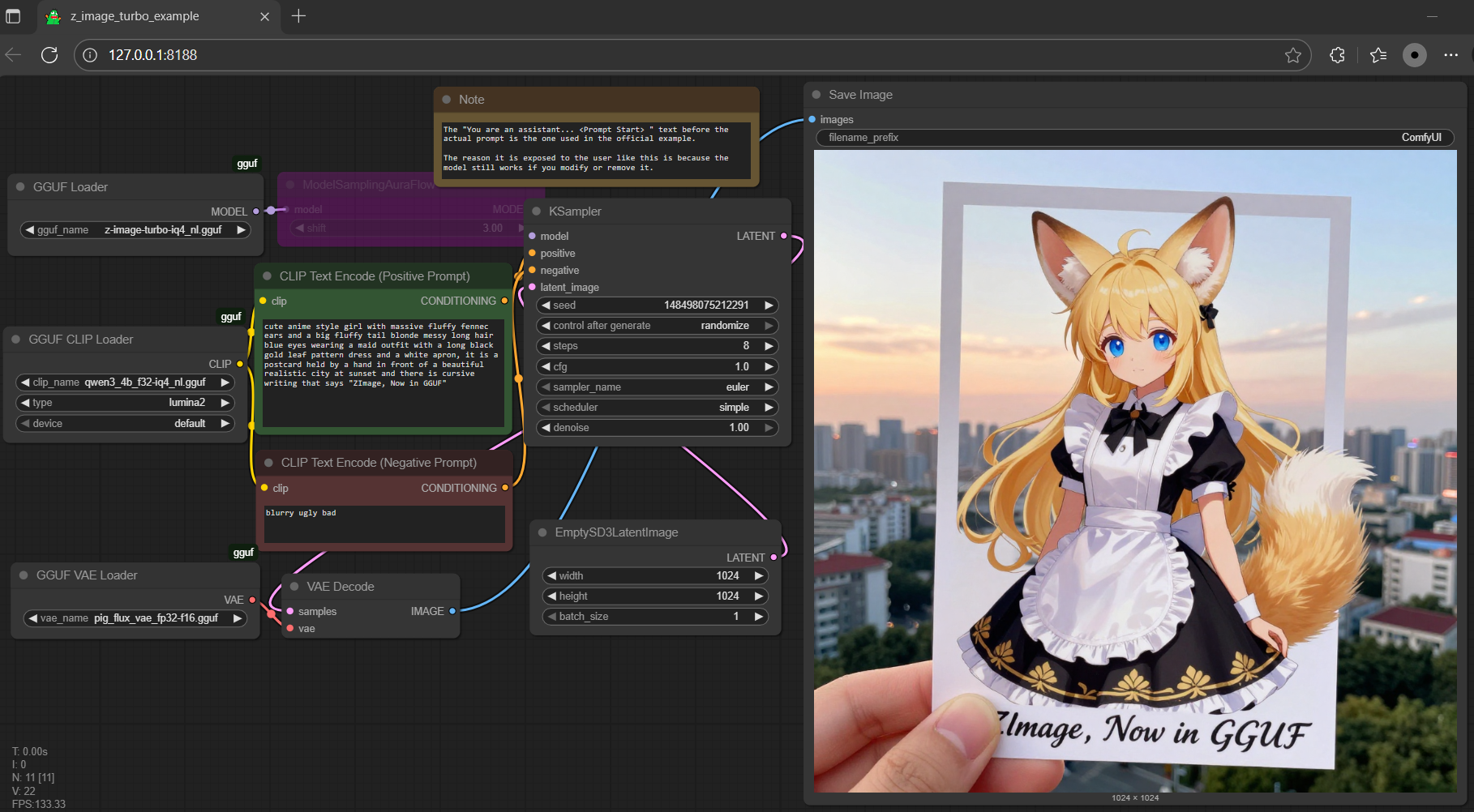

Imágenes

Instalación

Descargue los archivos GGUF y colóquelos en los directorios de ComfyUI: - Modelo Z-Image → ./ComfyUI/models/diffusion_models - Codificador Qwen3-4B → ./ComfyUI/models/text_encoders - VAE → ./ComfyUI/models/vae

Uso

Use con la extensión ComfyUI GGUF o la herramienta CLI gguf-connector. Ejecute 'ggc z1' para seleccionar e interactuar con los modelos GGUF.

Requisitos

- 6GB+ VRAM (RTX 2060 o equivalente)

- 16GB+ de RAM del sistema

- ComfyUI con la extensión GGUF

- Almacenamiento SSD (no HDD)

Enlaces relacionados

Herramientas populares

Explore nuestras herramientas creativas más populares

Z-Image Edit

Cargue una imagen, transfórmela con una frase

Motor Creativo

Una frase, la IA proporciona creatividad infinita para sus mensajes.

Image Parse

Cargue una imagen, obtenga el mensaje al instante.

Biblioteca de Prompts

Descubra miles de mensajes de IA de alta calidad.

Z-Image LoRA

Combina múltiples modelos LoRA para crear obras de arte de IA únicas

Z-Video

Generate creative videos from text or images with AI.

Generador de imágenes por IA

Convierta su texto en imágenes impresionantes al instante.

Biblioteca de Estilos

Explora estilos artísticos seleccionados para tus creaciones.

Quitar fondo

Elimina fondos de imágenes al instante con precisión de IA.

Escalador de imágenes

Mejora la resolución de la imagen hasta 4K/8K.

Reencuadre de imagen

Expande imágenes a cualquier relación de aspecto con outpainting.